robots.txt文件有大小限制吗

作者: 亦辰 网站建设 发布时间:2019-11-11 17:26 浏览次数:68

在我们做网站建设的初期会对网站内容做一个整体的规划,哪些是允许搜索引擎可以收录的,哪些是不允许搜索引擎蜘蛛爬行和收录的,那么我们如何告诉搜索引擎这些要求并让它遵守呐,这个时候我们就需要用到robots文件,下面站优云小编就来简单介绍一下这个文件。

robots.txt文件是什么,有什么作用:

百度百科解释:robots是网站跟爬虫间的协议,用简单直接的txt格式文本方式告诉对应的爬虫被允许的权限,也就是说robots.txt是搜索引擎中访问网站的时候要查看的第一个文件。当一个搜索蜘蛛访问一个站点时,它会首先检查该站点根目录下是否存在robots.txt,如果存在,搜索机器人就会按照该文件中的内容来确定访问的范围;如果该文件不存在,所有的搜索蜘蛛将能够访问网站上所有没有被口令保护的页面。

robots.txt文件设置要求:

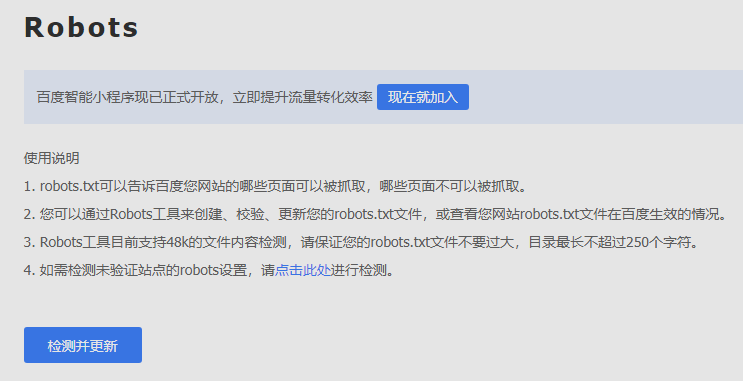

首先文件大小是有限制的,目前“Robots工具”支持48k的文件内容检测,请保证您的robots.txt文件不要过大,并且目录最长不超过250个字符;记得在在站长平台移动专区关于robots的答题正确答案也是这样说明的。

小编建议大家实际的Robots文件内容建议大小也参照这个,太大了肯定是不行的,严格来说是对搜索引擎不友好的。

下一篇:企业网站建设需要注意哪些策略规划

![[field:fulltitle/]](/images/seoantianjifei.jpg)

![[field:fulltitle/]](/images/zhengzhanyouhua.jpg)

![[field:fulltitle/]](/images/yuntaocao.jpg)

![[field:fulltitle/]](/images/wangzhanjianshe.jpg)